近年来,人工智能面部变化技术被电子欺诈犯罪所利用,案件继续上升。提醒用户加强人工智能面部变化电子欺诈骗局的警惕,提高自我保护意识,共同应对新的犯罪形势。共同保护财产安全。

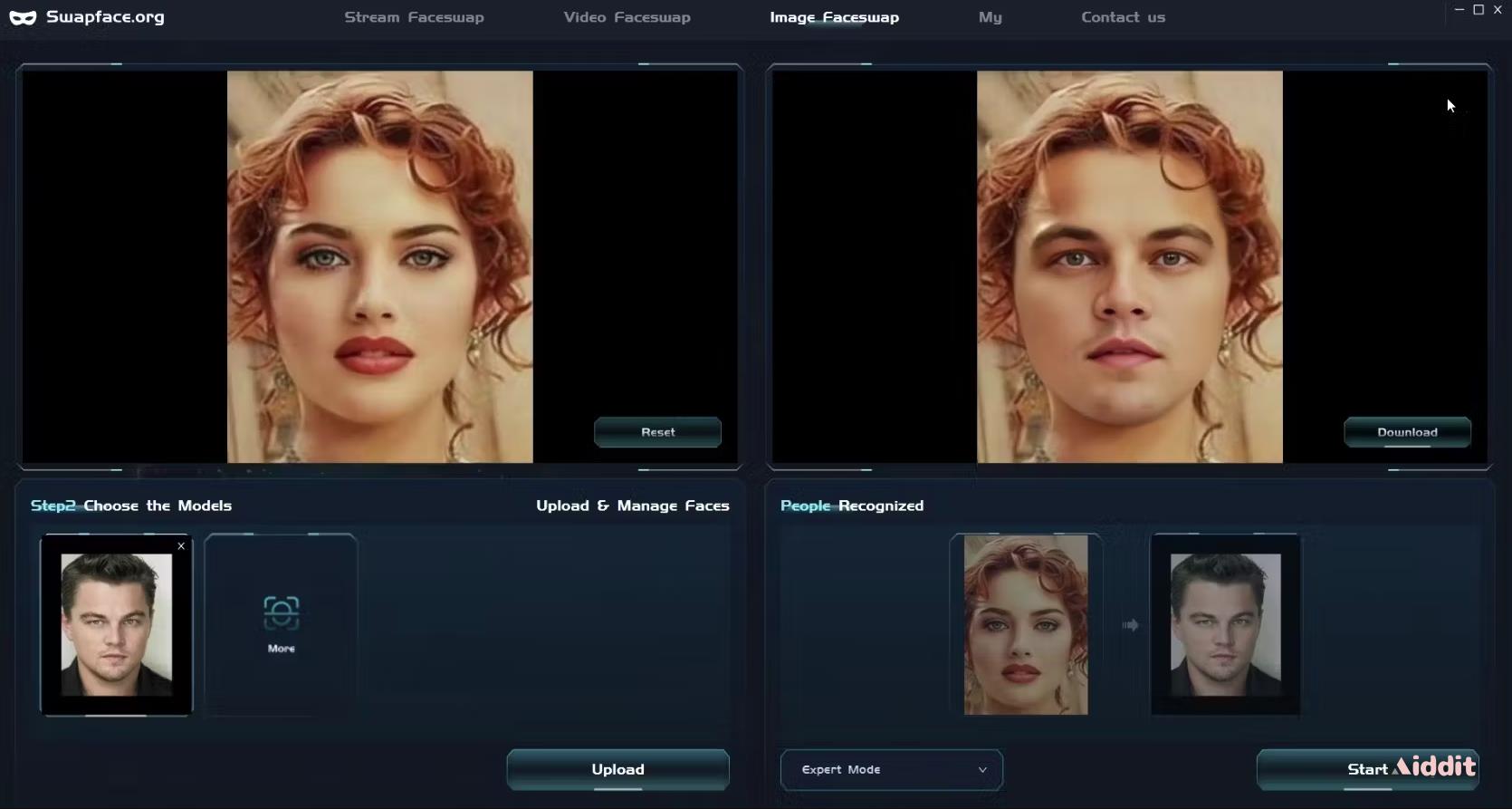

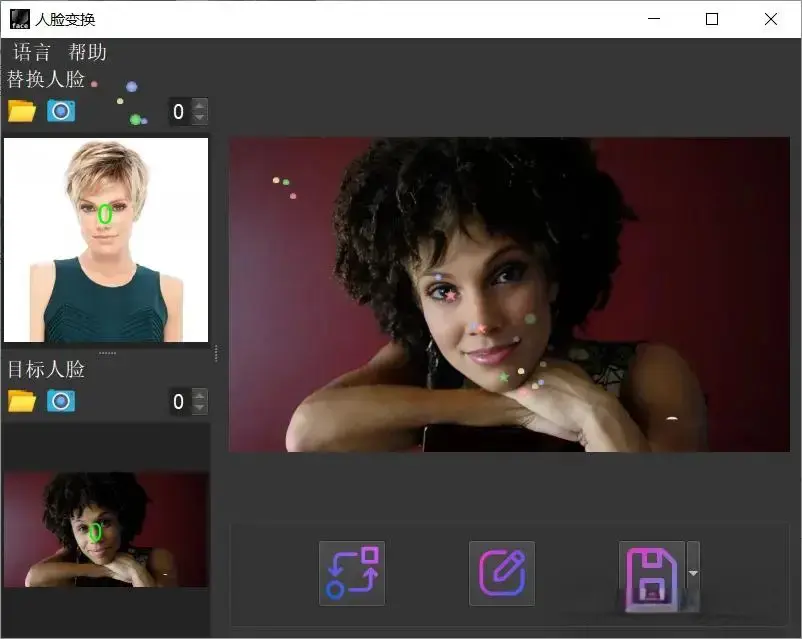

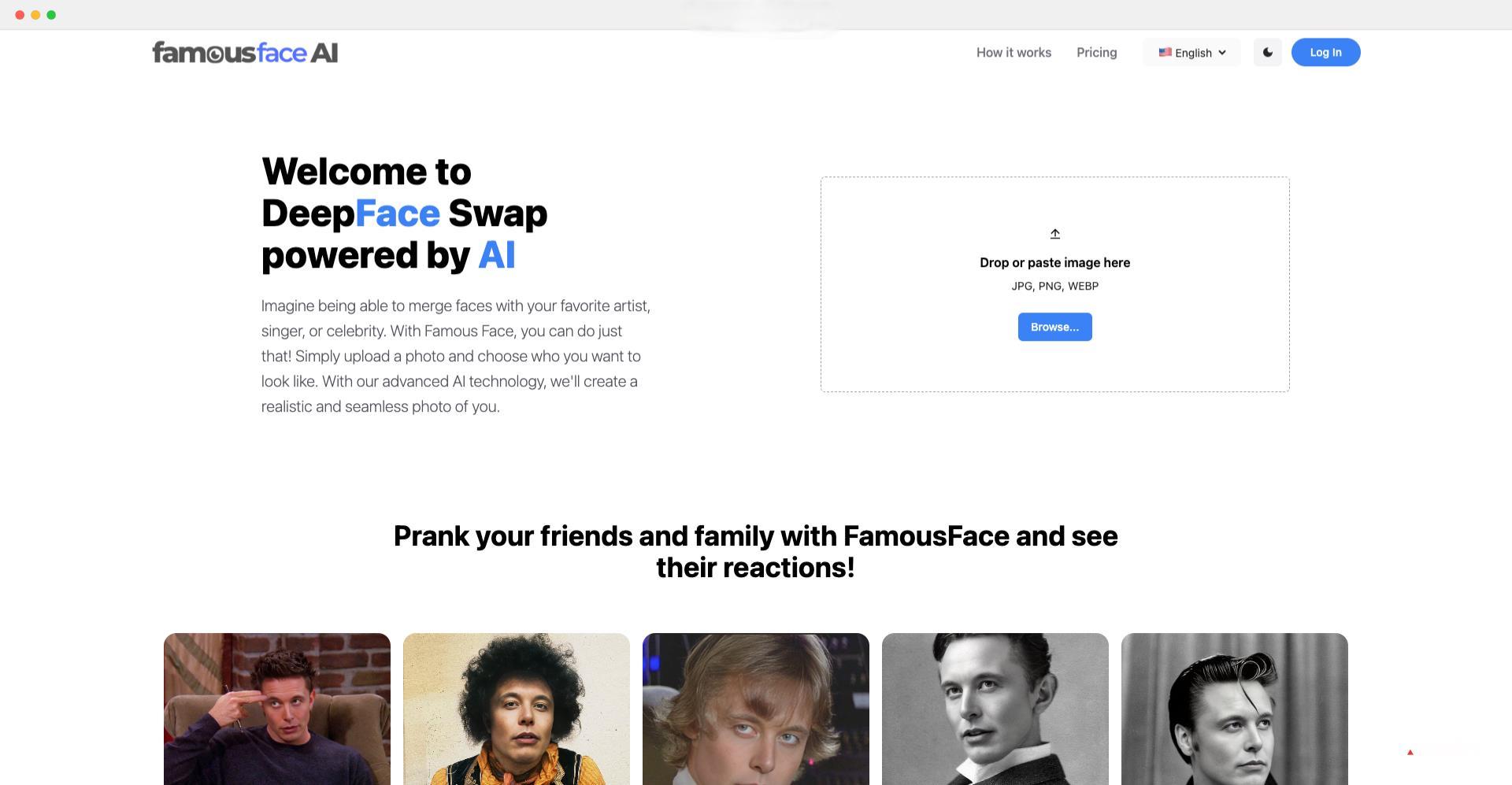

人工智能换脸技术可以通过人工智能算法替换人脸特征。电子欺诈者利用这个机会制作虚假视频,以达到欺骗用户的目的。以下是人工智能面部欺诈的基本手段:

1.伪装身份:电子欺诈者可以通过人工智能换脸技术伪装成受害者认识的人,制作虚假视频,声称在紧急情况下需要经济帮助。

2.欺骗认知:利用人工智能换脸技术,电子欺诈者可以在视频中模拟目标人物的表情和声音,使受害者更容易相信视频的真实性。

3.制造紧急情况:通过制作虚假视频,电信诈骗分子声称发生紧急情况,迫使受害人匆忙行动,达到非法获利的目的。

利用这些惯例,犯罪分子通常作为亲戚和朋友进行欺诈。在沟通过程中,犯罪分子通过虚构的紧急情况借钱,利用人工智能面部交换技术模拟受害者的声音和表情,进行虚假威胁,要求用户支付款项。

要想避免此类骗局,要注意以下细节:

1.保护个人信息:提高个人信息保护意识,仔细分享生活细节,减少欺诈者获取信息的机会。

2.谨慎处理视频请求:对于未知来历或突发视频请求,要保持警惕,谨慎处理,避免盲目相信视频内容。

3.核实信息真实性:在紧急情况下或请求财务援助时,通过其他渠道核实信息真实性,确保不被虚假视频欺骗。

4.提高安全意识:提高对电子诈骗技术的认识,了解人工智能换脸技术可能带来的风险,增强警惕性。