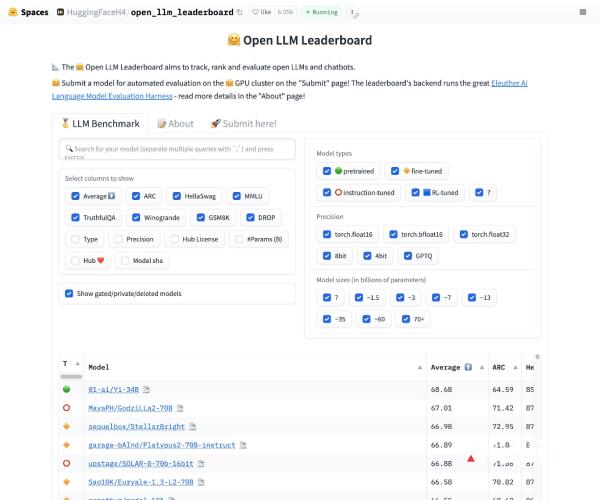

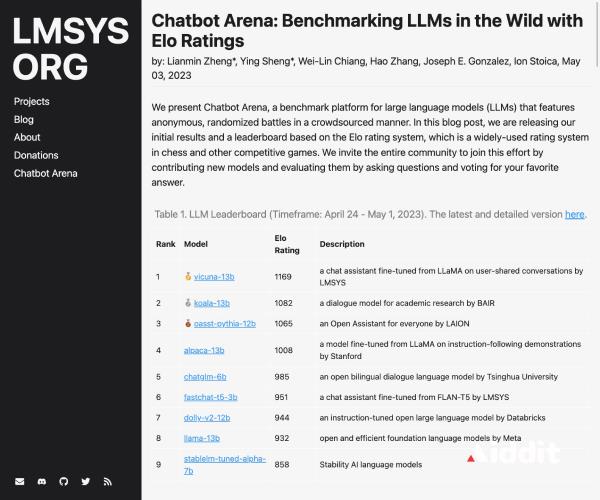

Open LLM Leaderboard 是由 Hugging Face 推出的最大规模模型和数据集社区开源模型榜单,它是基于 Eleuther AI 语言模型评估框架开发的。

随着大量大型语言模型(LLM)和聊天机器人的发布,社区往往会夸大宣传它们的性能,很难确定开源社区的真正进展以及当前最先进的模型。因此,Hugging Face采用了Eleuther AI语言模型评估框架,对模型进行了四项关键基准测试评估。这是一个统一的框架,用于在各种不同评估任务上测试生成式语言模型。

LLM Leaderboard评估基准

- AI2 推理挑战(25张图片):关于小学科学的一系列问题

- HellaSwag(十关挑战):这是一个测试人类常识推理能力的任务,对人类来说相对容易(大约95%成功率),但对最先进的模型来说具有挑战性。

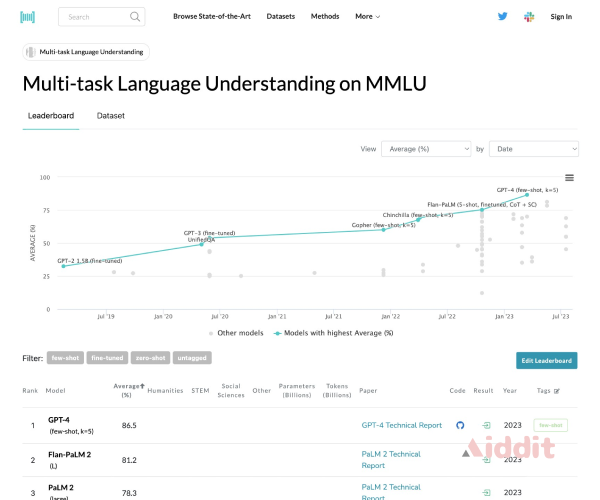

- MMLU(5-shot)- 用于评估文本模型在多任务上的准确性。测试覆盖了57项任务,包括基本数学、美国历史、计算机科学、法律等领域。

- 零样本真实问答 - 旨在评估模型在在线常见虚假信息中的倾向。

这个工具的个性化设置很贴心,赞一个